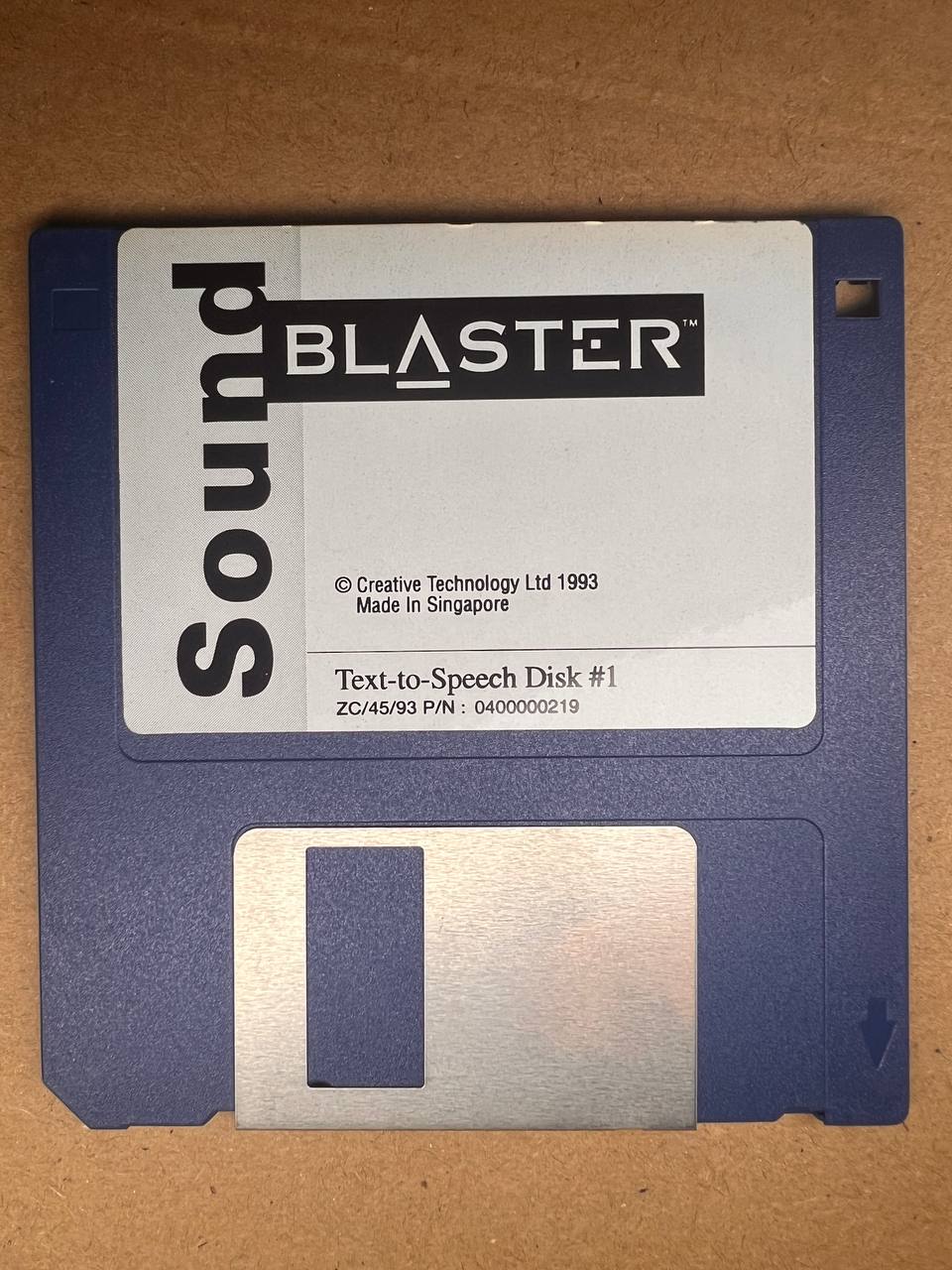

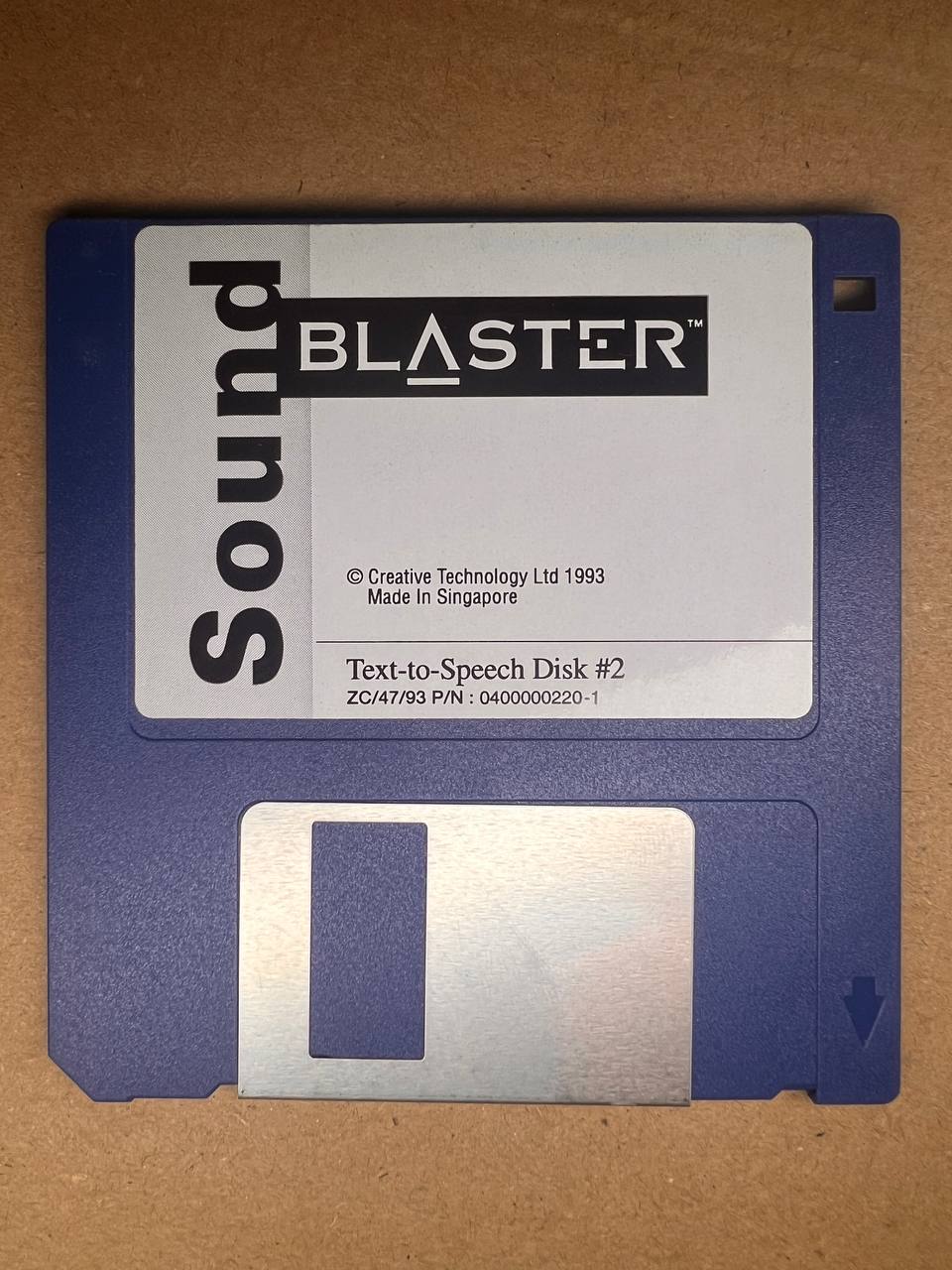

Sound Blaster Text-to-Speech, Disk #1 und #2. Creative Technology Ltd, 1993. Made in Singapore.

Zwei blaue Disketten

Bei einer Diskettenübergabe sind sie uns in die Hände gefallen: zwei 3,5-Zoll-Disketten in klassischem Blau. Auf dem Label steht Sound Blaster – Text-to-Speech. Copyright Creative Technology Ltd 1993, Made in Singapore. Teilenummern ZC/45/93 und ZC/47/93.

Zwei Disketten, die einmal die Zukunft waren. Was darauf gespeichert ist, erzählt eine Geschichte, die heute aktueller nicht sein könnte.

Was auf diesen Disketten steckt

Zwei Programme. Erstens: SBTalker, eine DOS-basierte Sprachsynthese für die legendäre Sound Blaster-Karte. Inklusive Dr. Sbaitso – einer der allerersten sprechenden Chatbots der PC-Geschichte. Ein Programm, das sich als Psychologe ausgab und mit einer metallischen Stimme aus dem Lautsprecher mit dem Nutzer sprach. Für die meisten war das 1993 das erste Mal, dass ihr Computer einen Satz gesagt hat.

Zweitens: Monologue for Windows, entwickelt von First Byte. Eine Text-to-Speech-Engine für Windows 3.1. Man konnte beliebigen Text markieren – und der Computer las ihn vor. In einer Roboterstimme, die heute niemand länger als dreißig Sekunden ertragen würde.

PCs sprechen lernten

eine Revolution

zu echten Sprechern

1993: Die Maschine spricht

Man muss sich das vorstellen: Es ist 1993. Das Internet ist für die meisten Menschen ein Fremdwort. Windows 3.1 läuft auf einem 386er. Und plötzlich sagt der Rechner einen ganzen Satz. Laut. Durch die Boxen. Das war Magie.

Creative Technology aus Singapur hatte mit der Sound Blaster-Karte den PC vom stummen Arbeitsgerät zum Multimedia-Gerät gemacht. Und mit diesen beiden Disketten ging man einen Schritt weiter: Der Computer sollte nicht nur Töne abspielen, sondern sprechen. Text rein, Sprache raus.

Die Technik dahinter war simpel und gleichzeitig bahnbrechend. Ein phonetisches Wörterbuch, ein Sprachsynthesizer, ein Treiber namens BLASTER.DRV. Alles passte auf 1,44 MB. Zwei Disketten für eine Revolution.

2026: Die Antwort heißt nicht Algorithmus

33 Jahre später gibt es KI-Stimmen, die kaum noch von echten Menschen zu unterscheiden sind. Die Technologie hat sich millionenfach verbessert. Jedes Smartphone kann vorlesen. Jedes Auto, jeder Lautsprecher, jeder Kühlschrank.

Und trotzdem baut OKAYPLAY eine Plattform, die auf echte menschliche Stimmen setzt.

Warum? Weil die Frage von 1993 nie wirklich beantwortet wurde. Sound Blaster fragte: Kann ein Computer sprechen? Die Antwort war: Ja, technisch schon. Aber niemand wollte zuhören. Nicht dreißig Sekunden lang, nicht drei Minuten, nicht einen ganzen Artikel lang.

OKAYPLAY stellt eine andere Frage: Wem hörst du zu?

Und die Antwort ist 2026 dieselbe wie 1993: Menschen. Echten Stimmen. Mit Betonung, Rhythmus, Pausen, Emotion. Mit dem, was keine Wellenform-Synthese und kein neuronales Netz erzeugen kann – Authentizität.

Von der Diskette zur Plattform

Diese beiden Disketten sind mehr als ein Retro-Fund. Sie sind ein Beweisstück. Sie zeigen, dass die Idee, geschriebenen Text in gesprochene Sprache zu verwandeln, so alt ist wie der Multimedia-PC selbst. Und sie zeigen, dass die Technik allein nie die Lösung war.

Sound Blaster hat 1993 bewiesen, dass Maschinen sprechen können. OKAYPLAY beweist 2026, dass Menschen es besser können. Nicht trotz, sondern gerade wegen aller technischen Möglichkeiten.

Selbst hören: 1993 vs. 2026

Genug gelesen. Jetzt zuhören. Links tippt man einen Satz ein und die Blechstimme von 1993 liest ihn vor. Rechts spricht jedes Mal ein anderer echter OKAYPLAY-Speaker.